Augustus 2026. Over vijf maanden moeten hoog-risico AI-systemen volledig compliant zijn aan de EU AI Act. Jouw planningsmodule, je kwaliteitscontrole, je chatbot: valt het onder hoog risico? De meeste organisaties weten het niet. Dit artikel geeft je alles wat je moet weten: van risiconiveaus en deadlines tot concrete stappen die je nu moet zetten.

Wat is de AI Act?

De EU AI Act is de eerste alomvattende AI-wet ter wereld. Waar de GDPR regelt hoe je met persoonsgegevens omgaat, regelt de AI Act hoe je AI-systemen mag bouwen, inzetten en gebruiken.

Het uitgangspunt is eenvoudig: hoe groter het risico dat een AI-systeem vormt voor mensen, hoe strenger de regels. De wet kijkt niet naar de technologie zelf, maar naar wat het systeem doet en welke impact het heeft.

De wet geldt voor iedereen die AI-systemen bouwt, verkoopt of gebruikt binnen de EU. Of je nu een tech-bedrijf bent dat AI agents ontwikkelt, een ziekenhuis dat diagnostische AI inzet, of een fabriek die werknemersprestaties monitort met AI.

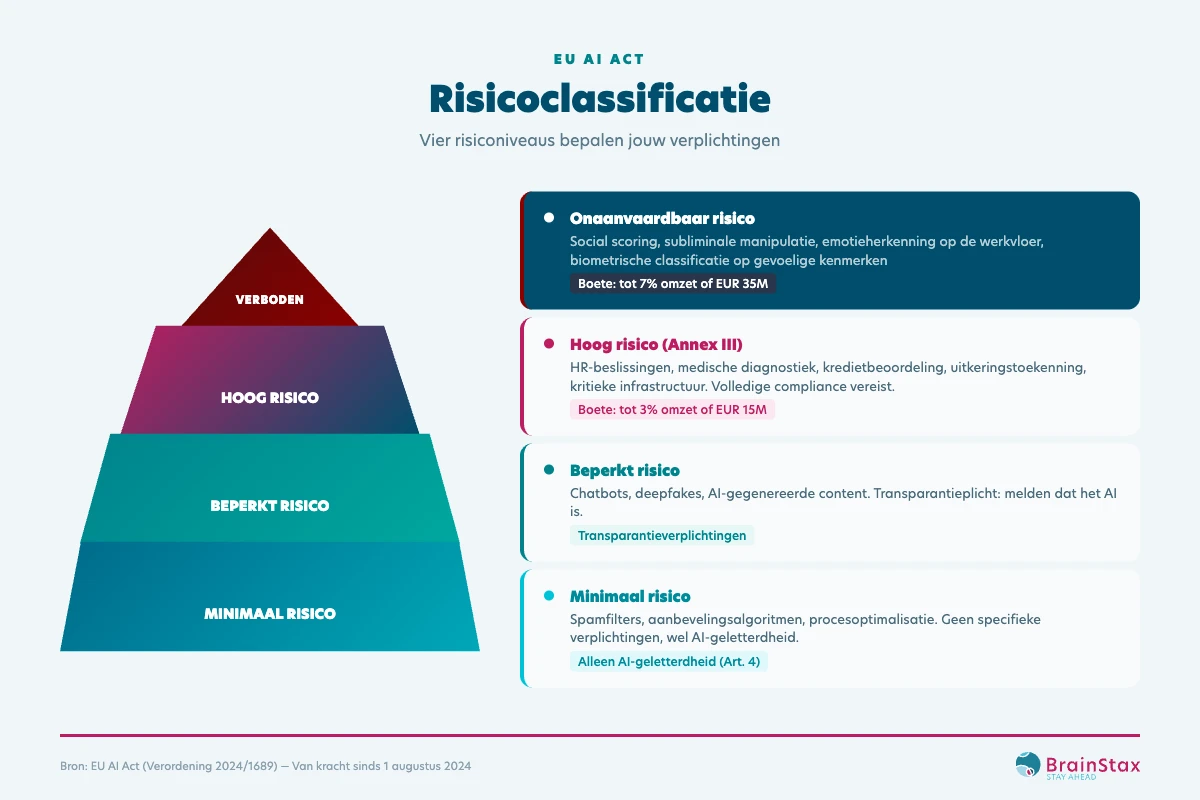

De vier risiconiveaus

De AI Act verdeelt alle AI-systemen in vier categorieen. Elk niveau brengt andere verplichtingen met zich mee.

Verboden (onaanvaardbaar risico)

Sommige AI-toepassingen zijn simpelweg verboden. Geen compliance-traject, geen uitzonderingen. Dit geldt sinds 2 februari 2025.

- Social scoring door overheden. Het beoordelen van burgers op basis van hun gedrag, zoals China dat doet.

- Emotieherkenning op de werkvloer. AI die de gemoedstoestand van werknemers analyseert. In fabrieken, warehouses, kantoren. Verboden.

- Subliminale manipulatie. AI die gedrag beinvloedt zonder dat mensen het doorhebben.

- Biometrische surveillance. Realtime gezichtsherkenning in openbare ruimtes (met smalle uitzonderingen voor rechtshandhaving).

De boete: tot 7% van je wereldwijde jaaromzet of EUR 35 miljoen, naar gelang welk bedrag hoger is.

Hoog risico (Annex III)

Dit is de categorie waar het voor de meeste organisaties spannend wordt. AI-systemen die beslissingen nemen of beinvloeden op gebieden die direct raken aan mensenrechten, veiligheid of fundamentele rechten.

De meest relevante domeinen voor de maakindustrie, zorg, publieke sector en logistiek:

- Werkgelegenheid (werving, prestatiebeoordeling, taaktoewijzing, ontslag)

- Kritieke infrastructuur (energie, water, transport)

- Essentiele diensten (krediet, verzekeringen, uitkeringen, nooddiensten)

- Biometrie (identificatie, categorisatie)

Daarnaast vallen ook onderwijs, rechtshandhaving, migratie/grensbewaking en rechtspraak onder hoog risico.

Voor deze systemen geldt een volledig compliance-pakket: risicomanagement, data governance, technische documentatie, menselijk toezicht, conformiteitsbeoordeling met CE-markering, en doorlopende monitoring na ingebruikname. Boete bij niet-naleving: tot 3% van je omzet of EUR 15 miljoen.

Beperkt risico

AI-systemen die direct met mensen interacteren moeten transparant zijn. Concreet: je moet melden dat het AI is. Dit geldt voor chatbots, AI-gegenereerde teksten, afbeeldingen, audio en video (deepfakes).

Geen zware compliance-verplichtingen, maar wel een wettelijke transparantieplicht.

Minimaal risico

Spamfilters, aanbevelingsalgoritmen, interne procesoptimalisatie. Geen specifieke AI Act-verplichtingen. Wel geldt voor alle organisaties die AI gebruiken de verplichting tot AI-geletterdheid (Artikel 4): je planners, teamleiders en kwaliteitsmanagers moeten voldoende kennis hebben van de AI-systemen waarmee ze werken.

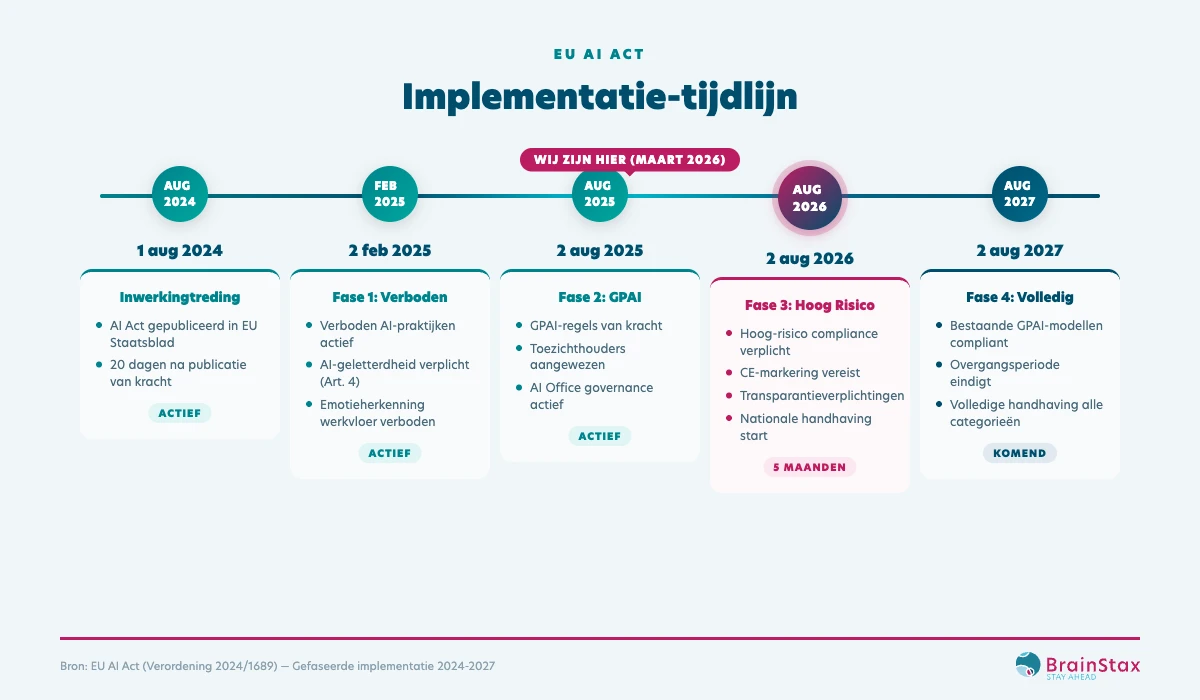

Tijdlijn: wat geldt er nu al?

De AI Act werkt met gefaseerde deadlines. Sommige verplichtingen gelden al. Andere komen eraan.

Nu al actief (sinds februari 2025)

- Alle verboden AI-praktijken zijn verboden. Punt. Als je organisatie emotieherkenning op de werkvloer inzet, ben je nu al in overtreding.

- AI-geletterdheid is verplicht. Iedereen die met AI werkt moet voldoende kennis hebben. Dit is een wettelijke verplichting, geen aanbeveling.

Actief sinds augustus 2025

- GPAI-regels (General-Purpose AI) zijn van kracht. Providers van foundation models zoals GPT-4 en Claude moeten technische documentatie en trainingsdata-samenvattingen publiceren.

- Nationale toezichthouders zijn aangewezen. In Nederland vijf stuks (daarover later meer).

Komend: 2 augustus 2026

Dit is de grote deadline. Vanaf deze datum:

- Hoog-risico AI-systemen moeten volledig compliant zijn

- CE-markering en registratie in de EU-database zijn verplicht

- Transparantieverplichtingen voor chatbots en AI-content worden actief

- Nationale handhaving start op volle kracht

Dat is over vijf maanden. De Europese Commissie heeft in november 2025 een voorstel gedaan (de "Digital Omnibus") om deze deadline mogelijk uit te stellen naar december 2027. Maar dat is een voorstel, geen wet. Plan op augustus 2026.

Wie draagt welke verplichtingen?

De AI Act maakt onderscheid tussen drie rollen. Elke rol draagt andere verplichtingen. Weet welke rol jouw organisatie speelt. De verplichtingen hangen ervan af.

GPAI Model Provider

Bedrijven zoals Anthropic (Claude), OpenAI (GPT-4) en Google (Gemini). Zij bouwen de foundation models waarop AI-toepassingen draaien. Hun verplichtingen: technische documentatie, trainingsdata-samenvattingen, copyright-beleid, en informatie aan downstream-gebruikers.

AI-systeem Provider (de bouwer)

Dit is de partij die een AI-systeem ontwerpt, bouwt en op de markt brengt. Denk aan je AI-leverancier, je implementatiepartner, of je eigen ontwikkelteam als je zelf AI bouwt. De provider draagt de zwaarste verplichtingen:

- Gedocumenteerd risicomanagement over de hele levenscyclus

- Data governance: kwaliteit, bias-detectie, representativiteit van trainingsdata

- Technische documentatie: architectuur, prestatiemetrieken, testresultaten, beperkingen

- Menselijk toezicht: override-mogelijkheid en stop-functionaliteit inbouwen

- Conformiteitsbeoordeling met CE-markering

- Post-market monitoring: doorlopend monitoren na deployment

Deployer (de gebruiker) — dit ben waarschijnlijk jij

De organisatie die een AI-systeem inzet onder eigen verantwoordelijkheid. Neem je een AI-oplossing af van een leverancier en gebruik je het in je operatie? Dan ben jij deployer. En dat brengt eigen verplichtingen met zich mee:

- Gebruik het systeem volgens de instructies van de provider

- Wijs bevoegd personeel aan voor menselijk toezicht

- Zorg voor kwalitatieve input data

- Voer een Fundamental Rights Impact Assessment (FRIA) uit als het systeem grondrechten raakt

- Informeer werknemers wanneer AI arbeidsbeslissingen beinvloedt

- Meld incidenten aan de provider en de toezichthouder

Belangrijk: als je als deployer het systeem substantieel wijzigt, het buiten het beoogde doel gebruikt, of het onder je eigen naam aanbiedt, word je automatisch provider. Met alle bijbehorende verplichtingen.

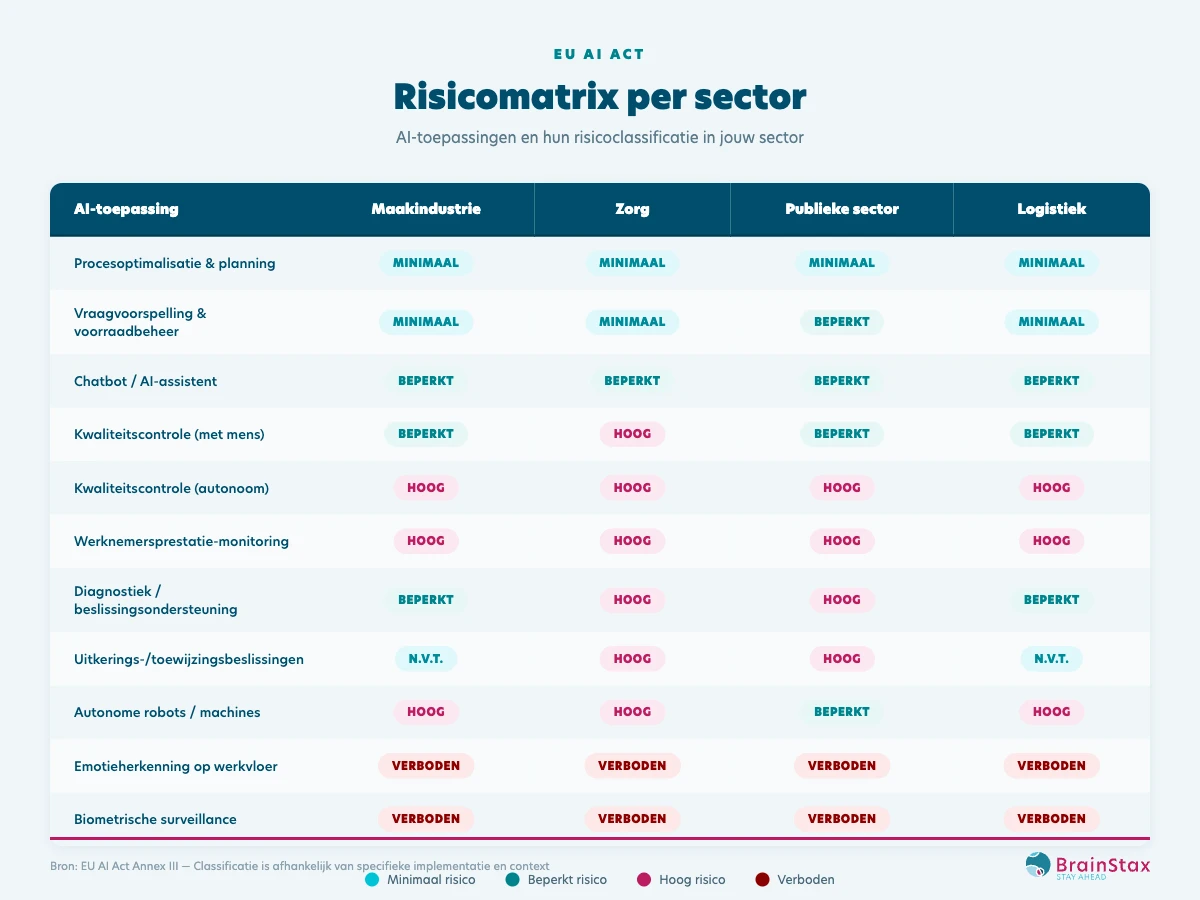

Wat betekent dit per sector?

De risicoclassificatie hangt af van wat je AI-systeem doet, niet van je sector. Maar sommige toepassingen komen vaker voor in bepaalde sectoren. Dit overzicht laat zien waar de risico's liggen.

Maakindustrie

Goed nieuws: veel AI-toepassingen in de maakindustrie vallen onder minimaal risico. Productieplanningen optimaliseren, voorspellend onderhoud, yield-optimalisatie. Daar heb je geen compliance-pakket voor nodig.

Maar let op. Zodra AI werknemersprestaties monitort of beoordeelt (individuele output, productiviteitsscores, afwezigheidspatronen), is het hoog risico. En als AI veiligheidscomponenten in machines aanstuurt (robotarmen, transportsystemen, noodstops), valt het onder de Machinerichtlijn. Dat is ook hoog risico.

En emotieherkenning op de werkvloer? Verboden. Geen discussie. Lees meer over AI in de maakindustrie.

Zorg

De zorg wordt het hardst geraakt. Vrijwel elke AI-toepassing die klinische beslissingen beinvloedt is hoog risico. Diagnostische ondersteuning, triage, behandeladviezen: het valt allemaal onder Annex I (medische hulpmiddelen) of Annex III (essentiele diensten).

Daar komt bij dat zorg-AI bijna altijd bijzondere persoonsgegevens verwerkt. Dat betekent dat naast de AI Act ook de GDPR in volle kracht van toepassing is. Dubbele compliance-last.

Administratieve AI (planning, facturatie, logistiek) is doorgaans minimaal risico. Maar zodra het de toegang tot zorg beinvloedt, verschuift het naar hoog risico. Bekijk hoe compliant AI werkt in de zorg.

Publieke sector

Overheden dragen extra verantwoordelijkheid vanwege de fundamentele rechten van burgers. AI die uitkeringen beoordeelt, fraudedetectie uitvoert, of semi-geautomatiseerde beslissingen neemt over burgers is hoog risico.

Informatieve chatbots die burgers wegwijs maken? Beperkt risico, met transparantieplicht. Maar zodra zo'n chatbot doorverwijst naar specifieke diensten of invloed heeft op aanvraagprocessen, kan het verschuiven naar hoog risico.

Publieke deployers moeten bovendien een Fundamental Rights Impact Assessment (FRIA) uitvoeren voordat ze hoog-risico AI inzetten. En ze moeten werknemersvertegenwoordigers informeren. Lees meer over AI in de publieke sector.

Logistiek

Routeoptimalisatie, loadplanning, vraagvoorspelling: minimaal risico. De kern van logistieke AI valt buiten de zware verplichtingen.

Maar ook hier geldt: werknemersprestatie-monitoring in warehouses is hoog risico. AI die chauffeurs beoordeelt op rijgedrag en dat koppelt aan arbeidsrechtelijke consequenties? Hoog risico. Autonome magazijnrobots die door AI worden aangestuurd? Check de Machinerichtlijn. Bekijk AI-toepassingen in de logistiek.

GPAI en foundation models

Gebruikt jouw organisatie ChatGPT, Claude, Gemini of een ander foundation model om AI-toepassingen te bouwen? Dan val je onder de GPAI-regels.

De verdeling is helder. De foundation model provider (OpenAI, Anthropic, Google) levert de technische documentatie, trainingsdata-samenvattingen en informatie die jij nodig hebt voor je eigen compliance. Jij, als bouwer van het resulterende AI-systeem, classificeert dat systeem op basis van de vier risiconiveaus en draagt de bijbehorende verplichtingen.

Concreet: als je Claude via de API gebruikt om een AI agent te bouwen die werknemersprestaties beoordeelt in een warehouse, dan is Anthropic de GPAI-provider en jij bent de provider van een hoog-risico AI-systeem. Met alles wat daarbij hoort.

De GPAI-regels zijn al actief sinds augustus 2025. De Europese Commissie heeft in juli 2025 richtlijnen gepubliceerd en er is een vrijwillige GPAI Code of Practice beschikbaar.

De AI Act en GDPR

De AI Act en GDPR zijn twee aparte wetten die naast elkaar bestaan. Wanneer een AI-systeem persoonsgegevens verwerkt, gelden beide. Bij conflict gaat de GDPR voor.

In de praktijk betekent dit dubbele compliance:

- De GDPR vereist een Data Protection Impact Assessment (DPIA) voor risicovolle verwerkingen

- De AI Act vereist een conformiteitsbeoordeling voor hoog-risico systemen

- Voor publieke deployers komt daar een Fundamental Rights Impact Assessment (FRIA) bij

Dit is geen theoretisch probleem. Zeven van de acht Annex III hoog-risico categorieen bevatten significante verwerking van persoonsgegevens. Wie hoog-risico AI inzet, heeft vrijwel altijd met beide wetten te maken.

De goede kant: veel principes overlappen. Data-kwaliteit, transparantie, menselijk toezicht. Wie de AI Act serieus implementeert, legt tegelijk een stevig GDPR-fundament.

Nederlandse toezichthouders

Nederland heeft vijf toezichthouders aangewezen voor de AI Act. Dat is bewust: elke sector krijgt specialistisch toezicht.

- Autoriteit Persoonsgegevens (AP): AI met persoonsgegevens, co-coordinator

- Rijksinspectie Digitale Infrastructuur (RDI): markttoezicht op AI-systemen

- Autoriteit Consument en Markt (ACM): consumentgerichte AI en mededinging

- Autoriteit Financiele Markten (AFM): AI in financiele dienstverlening

- De Nederlandsche Bank (DNB): AI in het bankwezen

De Uitvoeringswet AI-verordening is aangenomen. AP en RDI hebben inspectie- en sanctiebevoegdheden, inclusief toegang tot broncode. Dat laatste is nieuw. Bij een inspectie kan de toezichthouder vragen om je code in te zien.

Nederland loopt voorop. De AP heeft al voor de AI Act handhavend opgetreden tegen algoritmische discriminatie bij de Belastingdienst en de fraudedetectie in de sociale zekerheid. De toezichthouders zijn niet passief.

Boetes

De AI Act kent drie boetecategorieen:

| Categorie | Maximale boete | Percentage omzet |

|---|---|---|

| Verboden AI-praktijken | EUR 35 miljoen | 7% wereldwijde jaaromzet |

| Niet-naleving hoog-risico | EUR 15 miljoen | 3% wereldwijde jaaromzet |

| Onjuiste informatie aan toezichthouders | EUR 7,5 miljoen | 1% wereldwijde jaaromzet |

Ter vergelijking: de GDPR maximeert op EUR 20 miljoen of 4%. De AI Act gaat structureel verder. Een organisatie met EUR 1 miljard omzet riskeert bij verboden praktijken een boete van EUR 70 miljoen. Bij hoog-risico niet-naleving EUR 30 miljoen.

Dit zijn geen theoretische maxima. De AP heeft al GDPR-boetes van tientallen miljoenen opgelegd. Er is geen reden om aan te nemen dat AI Act-boetes milder zullen zijn.

Wat moet je nu doen?

Ongeacht je sector: er zijn stappen die je nu moet zetten. Niet in 2027. Nu.

Direct (Q1 2026)

- AI-inventaris: breng alle AI-systemen in kaart die je gebruikt, beheert of laat bouwen.

- Risicoclassificatie: bepaal per systeem of het verboden, hoog, beperkt of minimaal risico is. Documenteer je redenering.

- AI-geletterdheid: formaliseer je beleid. Dit is al verplicht sinds februari 2025.

- GPAI-gebruik: documenteer welke foundation models je gebruikt, hoe en waarvoor.

- Contracten: check je contracten met AI-leveranciers. Staat erin wie provider is en wie deployer? Is compliance-documentatie onderdeel van de afspraken?

Tweede kwartaal 2026

- Compliance-documentatie opzetten voor hoog-risico systemen

- Risicomanagement-framework implementeren (gedocumenteerd, iteratief)

- Data governance formaliseren (kwaliteitseisen, bias-detectie, representativiteit)

- Bias-testing protocol ontwikkelen (testen over demografische groepen)

Voor augustus 2026

- Conformiteitsbeoordelingen afronden voor hoog-risico systemen (samen met je AI-provider)

- Technische documentatie compleet per systeem — vraag deze op bij je leverancier

- Post-market monitoring inrichten: wie monitort, wie escaleert, wie meldt?

- Werknemers informeren als AI arbeidsbeslissingen beinvloedt

Weet je niet waar te beginnen? Start met een AI-inventaris. Breng in kaart welke AI je gebruikt, wie de provider is, en welk risiconiveau van toepassing is. Dat alleen al geeft je een helder beeld van wat er moet gebeuren.

De kans

Tot nu toe klinkt de AI Act vooral als een verplichting. Dat is het ook. Maar het is tegelijk een kans.

Compliance dwingt je om je AI-gebruik te documenteren, risico's te beoordelen en kwaliteit te borgen. Dat zijn geen bureaucratische exercities. Het zijn precies de stappen die het verschil maken tussen AI die waarde levert en AI die faalt. In een markt waar 80% van AI-projecten faalt, geeft een gestructureerde aanpak je een voorsprong op concurrenten die AI ad hoc inzetten.

Bovendien: klanten, toezichthouders en partners vragen steeds vaker om aantoonbare AI-governance. Wie dat nu regelt, hoeft straks niet in paniek in te halen. En wie een AI-partner kiest die compliance meelevert als onderdeel van de dienstverlening, heeft een probleem minder. Bekijk wat je van een goede AI-partner mag verwachten.

Mens, Data, Technologie: het juiste raamwerk voor compliance

De AI Act lijkt complex, maar de kern is eenvoudig. Elk compliance-vraagstuk valt uiteen langs drie assen: Mens, Data en Technologie. Altijd in die volgorde.

- Mens — Menselijk toezicht (Artikel 14). Wie in je organisatie is verantwoordelijk? Hebben je planners, teamleiders en kwaliteitsmanagers voldoende AI-kennis? Zijn stakeholders betrokken bij beslissingen die AI maakt?

- Data — Data governance (Artikel 10). Wat gaat er in je AI-systemen? Is de data kwalitatief, representatief, vrij van bias? Wordt data die rapporteert ook data die werkt?

- Technologie — Technische robuustheid (Artikel 15). Zijn je systemen getest? Is er een override? Draait het in productie of nog als pilot?

Dit is geen theoretisch model. De AI Act verplicht wettelijk wat goede AI-implementatie altijd al vereiste. Wie AI inzet met de mens als vertrekpunt, wie data-kwaliteit serieus neemt, en wie technologie pas inzet als het fundament staat, heeft al een sterke basis voor compliance.

Begin je AI Act readiness-check langs deze drie assen. Doe onze gratis AI Act Readiness Scan en ontdek in 3 minuten waar jouw organisatie staat. Je zult merken dat het meeste werk niet in technologie zit, maar in mensen en processen.

Veelgestelde vragen

Geldt de EU AI Act ook voor kleine organisaties?

Ja. De AI Act geldt voor iedereen die AI-systemen bouwt, verkoopt of gebruikt binnen de EU, ongeacht bedrijfsgrootte. Alleen voor aanbieders van AI-systemen met een omzet onder EUR 10 miljoen geldt een beperkte vrijstelling bij conformiteitsbeoordeling.

Wat is de deadline voor hoog-risico AI-systemen?

2 augustus 2026. Vanaf die datum moeten hoog-risico AI-systemen volledig compliant zijn met documentatie, CE-markering en post-market monitoring. Compliance-trajecten voor hoog-risico systemen duren doorgaans 6 tot 9 maanden. De tijd is krap.

Wat is het verschil tussen een AI-provider en een deployer?

Een provider bouwt en distribueert het AI-systeem en draagt de zwaarste verplichtingen. Een deployer gebruikt het systeem onder eigen verantwoordelijkheid. Als je een AI-oplossing afneemt en inzet in je operatie, ben jij deployer.

Wat kost niet-naleving?

Verboden AI-praktijken: tot EUR 35 miljoen of 7% van de wereldwijde jaaromzet. Niet-naleving van hoog-risico verplichtingen: tot EUR 15 miljoen of 3%. Dat is structureel hoger dan GDPR-boetes.

Volgende stap

Ben je al BrainStax-klant? Dan hoef je je over provider-compliance geen zorgen te maken. Wij zorgen dat de AI-systemen die we voor je bouwen voldoen aan de AI Act. Dat is onderdeel van ons partnerschap. Jouw deployer-verplichtingen pakken we samen op.

Nog geen klant? Dan moet je nu actie ondernemen. Augustus 2026 komt snel. Begin met onze gratis AI Act Readiness Scan: 6 vragen, 3 minuten, en je weet precies waar je staat. Classificeer je systemen en controleer of je huidige AI-leverancier compliance kan garanderen. Dit is waar je op moet letten.

Liever eerst meer lezen? Download ons paper over hypereffectieve AI-implementatie en ontdek hoe Mens, Data en Technologie de basis vormen voor AI die werkt en compliant is.